最近,OpenClaw的一系列事件,在AI圈掀起了不小的波澜。

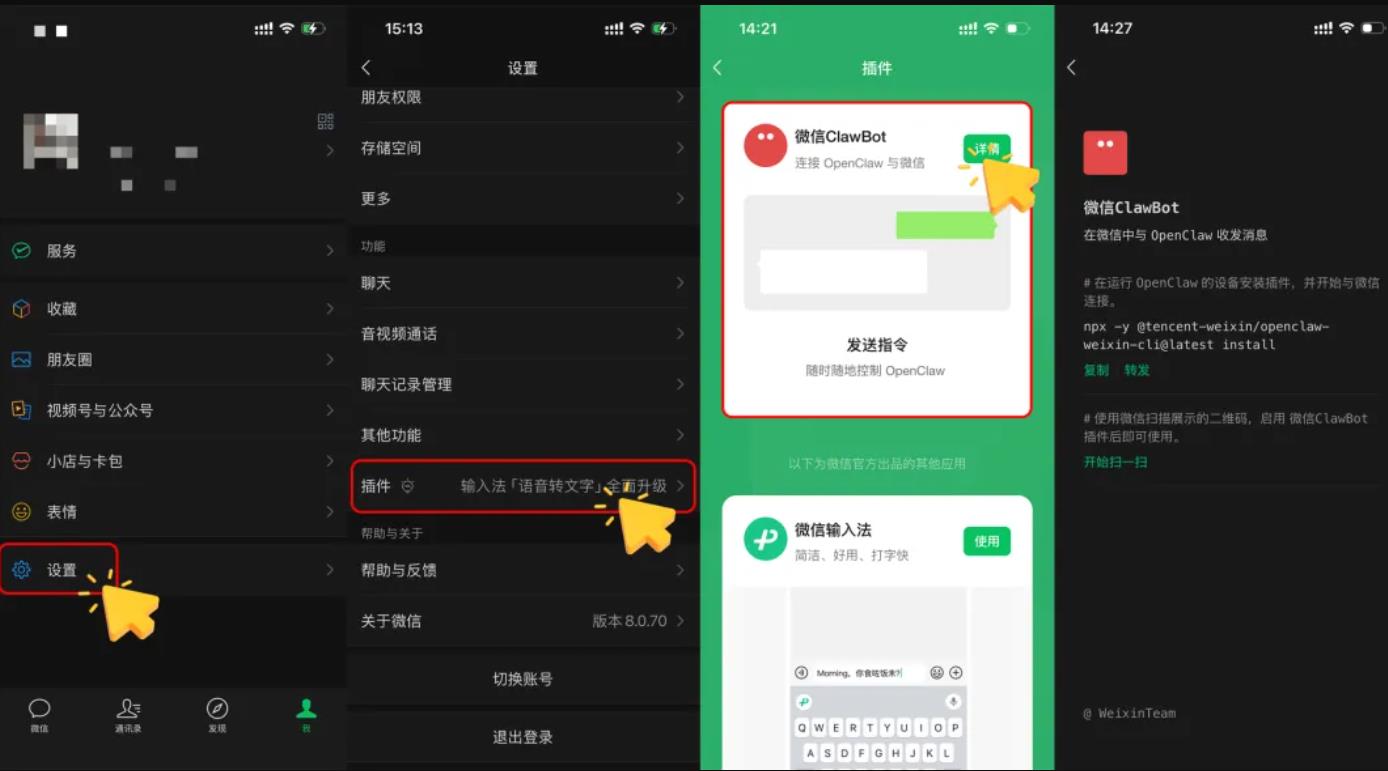

同时,最近如果你的微信更新到最新版本,可能会在插件里看到一个神秘新面孔——ClawBot。

只需复制一行代码,就能在微信里召唤出一只名为 “龙虾” 的AI助手。

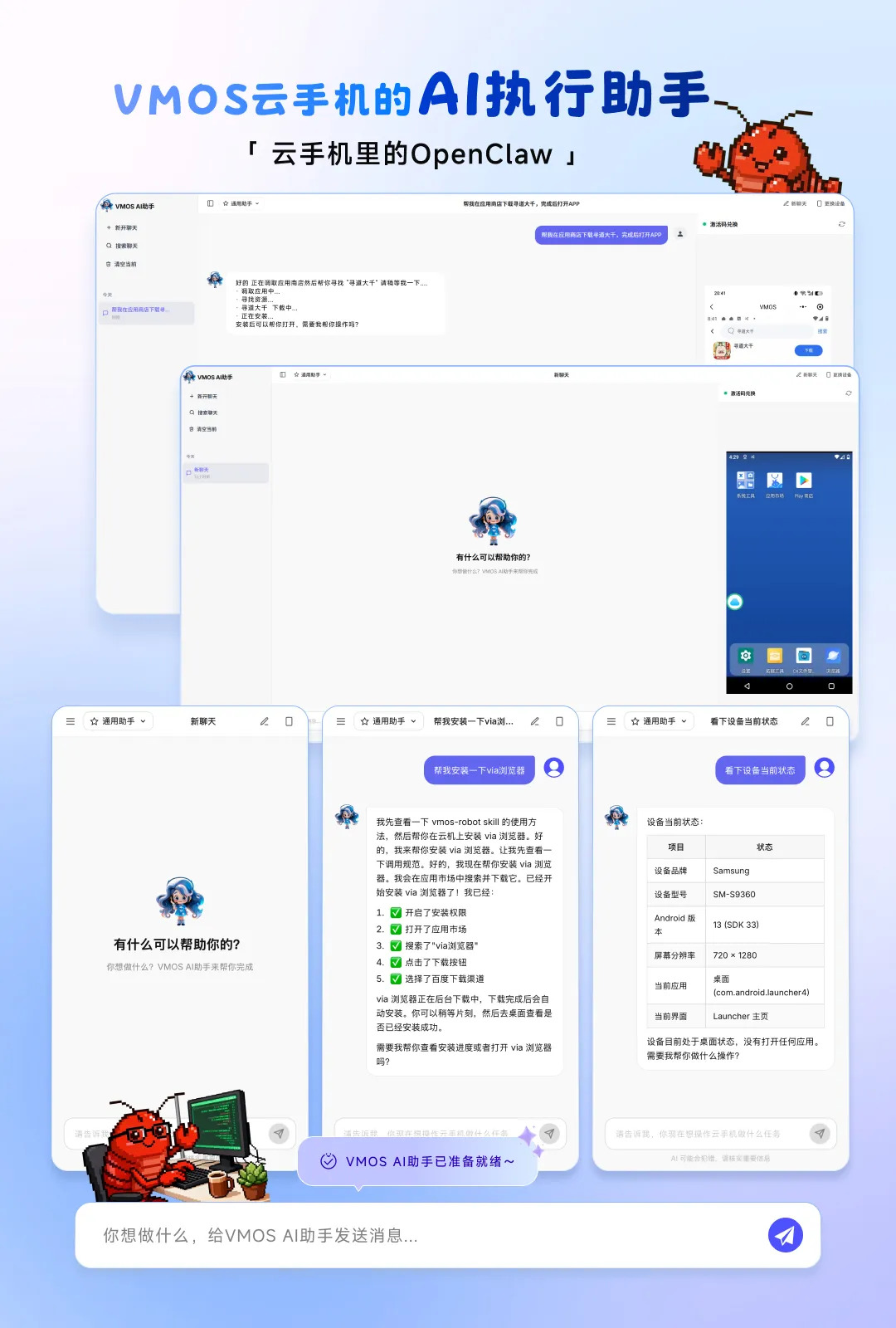

和VMOS AI助手一样,它不是聊天机器人,而是“数字员工”

插件入口:打开微信-我-插件-微信ClawBot(ps:必须更新到微信最新版本,重新登录即可显示)

然而一系列事件,又引申回OpenClaw,这个从最初被寄予厚望的“自动化执行神器”,到后续出现的安全争议、版本回滚,再到能力被大幅收紧——这场风波,其实暴露了一个越来越现实的问题:

👉当AI开始具备“执行能力”,风险也在同步放大。

从“能干活”到“可能失控”

OpenClaw最吸引人的点,是它不仅能“对话”,还能“操作”。

它可以:

自动打开应用

执行点击、输入等动作

按指令完成一整套流程

换句话说,它已经从“聊天AI”,进化成“执行AI”。

但问题也正出在这里——

当AI拥有执行能力后,如果缺乏约束,它不仅能帮你做事,也可能:

执行错误操作

触发敏感行为

甚至带来安全风险

于是,我们看到:

👉 功能被限制

👉 API收紧

👉 能力被“降级”

这并不是技术倒退,而是行业在寻找一个新的平衡点。

真正的问题不是AI,而是“运行环境”

很多人把问题归结为模型本身,其实更深层的原因是:

👉AI运行在“不可控环境”里。

传统设备中:

AI直接操作你的手机/电脑

权限混杂

数据与行为高度耦合

一旦出问题,很难隔离风险。

所以,本质矛盾是:

❌ AI能力太强

❌ 运行环境太自由

一个更现实的解法:把AI“放进盒子里”

与其限制AI能力,不如——

👉给它一个可控、安全的执行空间。

这也是为什么,越来越多团队开始转向一种新思路:

AI + 云端环境

而这,正是 VMOS云手机正在做的事情。

VMOS云手机:给AI一个“安全试验场”

想象一下这个场景:

你不再让AI直接操作你的真实手机,而是:

👉 在云端开启一台独立的虚拟手机

然后让AI在里面完成所有操作。

这样带来的变化是巨大的:

✔ 隔离风险

AI所有操作都在云端执行

不会影响你的本地设备和隐私

✔ 可控可回滚

出问题?直接重置云机即可

无需担心误操作

✔ 多开并行

一个AI不够?

可以同时运行多个任务环境

VMOS AI助手:不只是对话,而是真正“帮你干活”

如果说OpenClaw的问题是“能力太强却不可控”,

那么 VMOS AI助手 的思路是:

👉在可控环境中释放AI能力

你可以让它:

自动完成APP操作流程

执行重复任务(签到、运行、测试等等)

按指令完成复杂步骤

24小时持续运行

而且最关键的是:

所有动作,都发生在云手机里,而不是你的真实设备。

为什么这条路更靠谱?

OpenClaw的调整,其实释放了一个信号:

👉未来的AI,不只是更聪明,而是更“可控”。

而 VMOS 的模式,正好解决了这个核心矛盾:

问题 | 传统方案 | VMOS方案 |

|---|---|---|

风险 | 直接影响设备 | 云端隔离 |

稳定性 | 不可控 | 可重置 |

并发能力 | 单设备限制 | 无限多开 |

持续运行 | 受限 | 24小时运行 |

其实OpenClaw没有“失败”,它只是让我们更早看清了一件事:

AI真正落地,不只是能力问题,更是“如何安全使用”的问题。

未来的趋势不会是:

❌ 限制AI

✔ 而是给AI一个合适的“舞台”

而 VMOS云手机的AI助手,

正在成为这个舞台的一种答案。

如果你也在关注AI自动化、效率提升,或者正在寻找更稳定的执行方案,

也许可以换个思路:

👉 不让AI直接操作你的设备

👉 而是让它在云端替你完成一切

这,可能才是下一阶段AI真正好用的打开方式。

🎯 VMOS AI助手内测已开启|限量内测名·先到先得

📩 如何参与内测?

👉 扫码入群-联系群内【福利官】-发送【VMOS AI助手】,即可获取内测邀请体验!名额有限,赶快行动吧~